【衝撃】AIが書いたコードをAIがレビューする時代へ。「Claude Code Review」のヤバすぎる仕組みとAnthropicの覇権戦略

Claude Codeの生みの親であるBoris Cherny氏から、とんでもない新機能が発表されました。その名も「Code Review」。

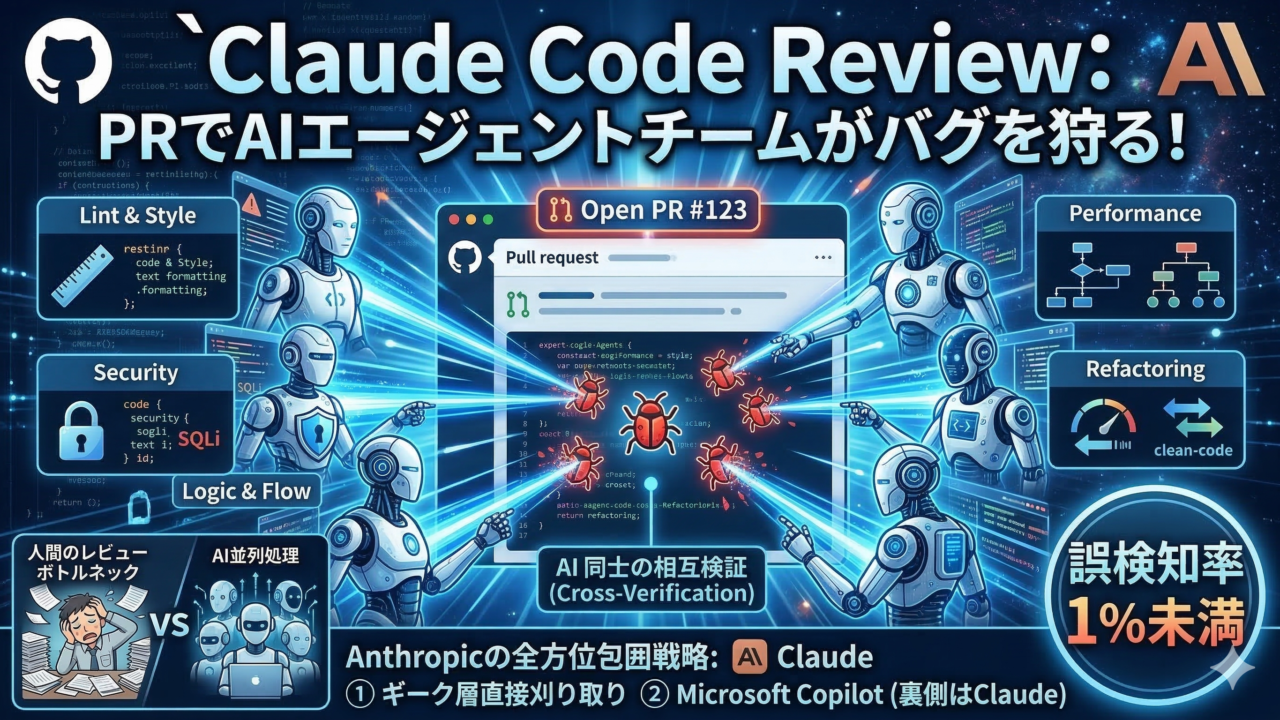

プルリクエスト(PR)を出した瞬間に、AIエージェントのチームが並列で起動し、バグを狩りに行くという恐ろしい機能です。今回は、この機能がなぜ生まれたのか、その驚異的なスペック、そしてAnthropicが仕掛ける「エグすぎる戦略」について紐解いていきます。

なぜ「AIによるレビュー」が必要になったのか?

背景にあるのは、皮肉にも「AIによる圧倒的な生産性向上」です。

Anthropicのエンジニアのコード出力は、今年に入って200%も爆増しました。AI(Claude Codeなど)のサポートによってコードを書く速度が限界突破した結果、今度は「人間のレビューが全く追いつかない」という深刻なボトルネックが発生してしまったのです。

「AIが爆速で書いたコードのレビューで人間が消耗しているなら、レビュー自体もAIにやらせてしまえばいい」。この極めて合理的、かつ野心的な発想から生まれたのが今回のCode Reviewです。

エージェント同士が相互検証する「Code Review」の仕組み

単なる「AIへのコードコピペ」とは次元が違います。システムとしての完成度が桁違いです。

- 並列処理によるバグハンティング: PRが開かれた瞬間、複数のAIエージェントが独立してコードを読み込み、多角的な視点からバグを探し始めます。

- AI同士の「相互検証(Cross-Verification)」: 最も画期的なのがここです。エージェント同士が互いの指摘を検証し合うことで、AI特有の「誤検知(ハルシネーション)」を徹底的に潰します。

- 重要度順のランキング報告: 残った本質的な問題だけを重要度順にソートして人間に報告します。

- コストとスピード: 1回のディープなレビューにかかる時間は約20分。コストは$15〜25。シニアエンジニアの時給を考えれば、破格の投資対効果です。

数字が証明する「エグい」実力

導入前後のデータが、この機能の威力を物語っています。

特に「誤検知率1%未満」という数字は驚異的です。AIレビューツールでありがちな「的外れな指摘ばかりで逆に疲れる」という問題を、マルチエージェントの相互検証で見事にクリアしています。

【補足】Bun作者も乗り換える?界隈のざわつき

界隈では、JavaScriptランタイム「Bun」の作者であるJarred Sumner氏が、このClaude Code Reviewを高く評価しているという噂も飛び交っています。彼は2025年8月時点では競合の「CodeRabbit」を強く推していた人物。一次ソースは現在確認中ですが、もしこれが事実であれば、トップ層のデベロッパーの間で相当なパラダイムシフト(乗り換え)が起きていることになります。

何が本質的に「ヤバい」のか?

Boris Cherny氏は以前、「もうコーディング(コードを書くこと)は解決済みだ」と語っていました。そして今回、「レビュー」すらも解決しに来たわけです。

「AIが書いたコードを、AIがレビューする」

この構図が完成した瞬間、ソフトウェア開発における人間の役割は劇的に変わります。コードの文法やバグに頭を悩ませる時代は終わり、人間に残された仕事は「何を作るかを決める(要件定義・設計)」ことと、「最終的な判断を下す(承認)」ことだけになります。

Anthropicの「全方位包囲網」という恐るべき戦略

そして、このニュースをさらに面白く(かつ恐ろしく)しているのが、発表のタイミングです。

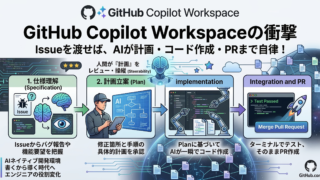

実は全く同じ日に、Microsoftが「Copilot Cowork」を発表しています。そしてなんと、このCopilot Coworkの裏側で動いているのは、OpenAIのモデルではなくAnthropicのClaudeなのです。

つまりAnthropicは今、

- 自社のClaude Code Reviewで、コアな開発者やギーク層を直接刈り取りつつ、

- Microsoftのプラットフォームを通じて、約4億人とも言われるエンタープライズ(商用)ユーザーにも同時にリーチしている。

という状態を作り出しています。開発者体験(DX)の最前線から、大企業のインフラまで、すべてをClaude色に染め上げる。この戦略のしたたかさは、まさに「エグい」の一言に尽きます。

コードを書くのも、レビューするのもAI。私たちは今、ソフトウェア開発の歴史が切り替わる「特異点」をリアルタイムで目撃しているのかもしれません。